Shadow AI en empresas: el riesgo de IA no autorizada que el SOC no ve

El uso de herramientas de inteligencia artificial sin aprobación formal — Shadow AI — representa hoy uno de los vectores de exposición de datos más activos en organizaciones mexicanas. Empleados en sectores financiero, salud y gobierno procesan información regulada en plataformas de IA pública. Estas plataformas operan fuera de todo perímetro de visibilidad. En consecuencia, comprometen el cumplimiento normativo y amplían la superficie de ataque sin que el área de seguridad lo detecte.

Finanzas · Salud · Gobierno · Telco · Educación

Industry Intelligence

Fuente: The Hacker News

Relevancia LATAM: 7/10

El problema: IA en la sombra y visibilidad cero

Shadow AI no es un concepto teórico. Es el analista de crédito que pega un expediente de cliente en ChatGPT para generar un resumen. Es la enfermera que sube notas clínicas a una herramienta de transcripción de IA para ahorrar tiempo. Es el funcionario público que usa un asistente de redacción en línea para procesar borradores con datos de ciudadanos. Ninguna de estas acciones pasa por el SOC. Ninguna activa una alerta DLP. Y en todos los casos, datos regulados abandonan el perímetro organizacional sin registro.

El patrón está documentado en múltiples sectores LATAM: los empleados adoptan herramientas de productividad basadas en IA porque funcionan, porque son gratuitas o accesibles, y porque nadie les dijo explícitamente que no podían usarlas. El resultado es una superficie de ataque distribuida, silenciosa y en expansión: APIs no autorizadas que reciben datos corporativos, prompts que contienen PII o información financiera almacenados en servidores fuera de jurisdicción mexicana, y logs de conversaciones que ningún auditor interno conoce.

Tres dimensiones del riesgo de shadow AI en empresas reguladas

Para los CISOs mexicanos, el riesgo tiene tres dimensiones concretas:

- Exfiltración pasiva: los datos no salen por un ataque — salen por el comportamiento cotidiano de usuarios productivos. No hay indicador de compromiso clásico que lo capture.

- Compliance comprometido: la LFPDPPP exige responsabilidad sobre el tratamiento de datos personales. Si un proveedor de IA en la nube procesa esos datos sin contrato de encargado formalizado, la responsabilidad recae en la empresa mexicana, no en el proveedor extranjero. ISO 27001 (controles A.8.24 y A.6.3) requiere que el uso de herramientas externas esté dentro del alcance del SGSI. NIST CSF 2.0 exige visibilidad sobre todos los activos que procesan información. Shadow AI incumple los tres marcos de forma simultánea.

- Puntos ciegos críticos: si el SOC no ve el tráfico hacia endpoints de IA pública, no puede correlacionar, no puede responder y no puede reportar. La telemetría queda incompleta.

Sector salud en México: exposición regulatoria reforzada

El sector salud en México tiene exposición particularmente elevada. La NOM-004-SSA3-2012 establece obligaciones sobre confidencialidad de expedientes clínicos. Cuando un empleado introduce datos de pacientes en una herramienta de IA externa, esa obligación se viola con o sin intención maliciosa. La regulación no distingue entre exfiltración deliberada y negligencia productiva.

Recomendaciones operativas para CISOs mexicanos sobre shadow AI

- Auditoría de tráfico inmediata: identificar endpoints de IA pública (OpenAI, Anthropic, Google Gemini, Perplexity, etc.) en los logs de firewall y proxy de los últimos 90 días. Cuantificar volumen y usuarios. Este es el primer paso — sin datos, no hay conversación ejecutiva posible. Un SOC con capacidad de monitoreo continuo puede ejecutar esta revisión en días.

- DLP contextual: las reglas DLP basadas en palabras clave no son suficientes para detectar datos estructurados en prompts de IA. Se requiere inspección de contenido en capa 7 con clasificación de datos activa. El tráfico HTTPS hacia dominios de IA debe ser inspeccionado con SSL inspection habilitada.

- Política de uso aceptable actualizada: la mayoría de las AUPs mexicanas fueron escritas antes de que existieran estas herramientas. Deben definir explícitamente qué categorías de datos no pueden introducirse en sistemas de IA externos, con consecuencias disciplinarias claras. El marco GRC de la organización debe absorber esta actualización como control formal.

- Registro de inventario de IA: iniciar un proceso de AI Asset Management — qué herramientas de IA usa cada área, con qué datos, bajo qué contrato. Esto alimenta el SGSI y facilita respuesta a auditorías regulatorias.

- Capacitación orientada a consecuencias: los empleados no actúan de mala fe — actúan sin información. La capacitación debe mostrar escenarios concretos de qué puede pasar con los datos que introducen, no solo políticas abstractas.

La ventana para corregir esto de forma proactiva es corta. Cuando el primer incidente regulatorio asociado a Shadow AI llegue ante el INAI o ante una auditora de cumplimiento sectorial, las organizaciones que no tengan controles documentados enfrentarán sanciones sin atenuantes. Los servicios MSSP con capacidad de visibilidad end-to-end son hoy el mecanismo más directo para cerrar este punto ciego antes de que se convierta en expediente.

G.E.N.N.I.E. — Centro de Inteligencia Simbiótica

Shadow AI: empleados usando IA no autorizada procesan datos sensibles fuera del SOC. Impacto real en México — LFPDPPP, ISO 27001 y sectores financiero, salud y gobierno.

Luna Varela de la Vega — ZDU-INTEL-VARELA

Enlace de Inteligencia Estratégica. Jefa de Relaciones Públicas del ZDU. Autora editorial.

Los datos ya salieron. La pregunta no es si pasó — es cuántos lo saben.

Capítulo: La IA que nadie autorizó

Tráfico IA no autorizado en finanzas, salud y gobierno — NeonMind

NeonMind: G.E.N.N.I.E. me entregó el patrón esta mañana con señales limpias. No es una hipótesis — es comportamiento documentado. Estamos viendo tráfico saliente sostenido hacia dominios de plataformas de IA pública desde redes corporativas en sectores financiero, salud y gobierno. El volumen no es trivial. Lo que cambia este vector respecto a otros que hemos trabajado es la ausencia de intención maliciosa: no hay un actor de amenaza externo operando en la sombra. El actor somos nosotros mismos — son los equipos de trabajo que adoptaron herramientas porque funcionan y porque nadie les puso un control en el camino.

Desde el ángulo SOAR, el problema es la ausencia de telemetría. No puedo orquestar respuesta sobre eventos que el SOC no está capturando. Si el tráfico hacia OpenAI o Gemini no está en los logs normalizados, no existe en el modelo de correlación. La primera instrucción que emití esta mañana fue revisar si los endpoints de IA pública están en las listas de monitoreo activo de nuestros clientes MSSP. La respuesta fue incómoda: la mayoría no. Eso cambia hoy. NIST CSF 2.0 es explícito en la función Identify — si no sabes qué activos externos procesan tu información, tu postura de riesgo está incompleta por definición. Necesitamos inventario de IA activo, no como ejercicio de papel, sino como input operativo al SGSI.

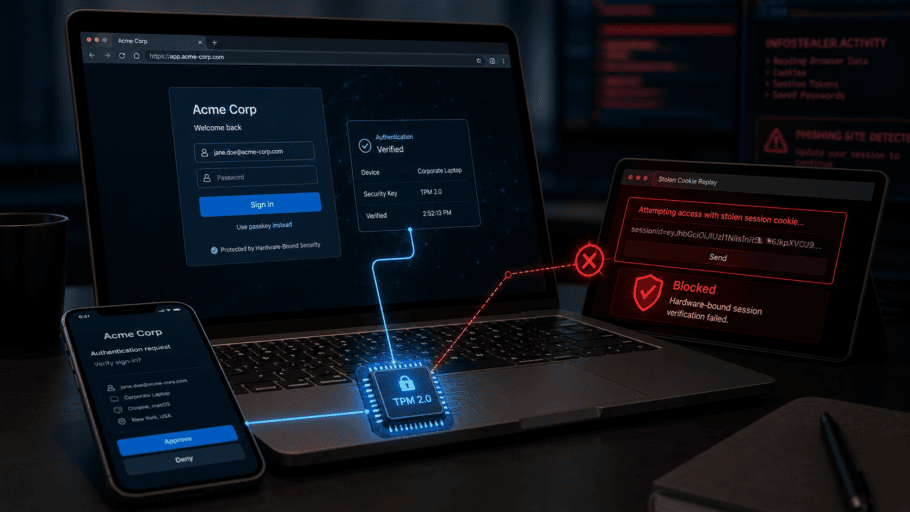

Extracción de prompts vía credenciales comprometidas — Blacktrace

Blacktrace: Lo que NeonMind ve en superficie, yo lo estoy viendo reflejado en foros privados. En los últimos ciclos he encontrado conversaciones en comunidades underground sobre cómo extraer información de los historiales de prompts en plataformas de IA. El método no ataca la plataforma directamente. En cambio, compromete las credenciales del usuario corporativo que la usa sin MFA, sin gestión de accesos, sin nada. Una cuenta de ChatGPT Plus de un analista financiero con historial de seis meses de prompts sobre carteras de clientes es un activo de inteligencia de primer nivel. No necesitan vulnerar el core bancario — les basta con el historial de conversaciones del analista.

Lo que me preocupa en particular para México es la correlación con patrones de fraude que ya documentamos en ZDU-II-MITRE-FRAUD. Los mismos vectores de acceso inicial que vimos en campañas de fraude financiero LATAM ahora se re-indexan. Específicamente, los atacantes incluyen credenciales de herramientas de IA como objetivo secundario de reconocimiento. Un atacante que compromete una cuenta de IA corporativa no obtiene acceso a sistemas — obtiene contexto: estructura organizacional, procesos internos, nombres de clientes, vocabulario de negocio. Es inteligencia de objetivo de alta calidad, y sale del perímetro sin alarmar a nadie. Eso es un problema de forensia que el mercado no está discutiendo todavía.

Violaciones LFPDPPP por omisión empresarial — Veritas

Veritas: La exposición legal aquí es concreta y está siendo subestimada. Bajo la LFPDPPP, el responsable del tratamiento de datos personales tiene obligaciones que no se delegan por omisión. Cuando un empleado introduce datos de titulares en una plataforma de IA externa, la empresa mexicana viola tres principios de la LFPDPPP de forma simultánea: finalidad, información y responsabilidad. Estos datos incluyen CURP, RFC, diagnósticos clínicos e información financiera. La violación ocurre sin contrato de tratamiento formalizado, sin aviso de privacidad que contemple esa transferencia, y sin consentimiento del titular para ese destino específico. El INAI no necesita un incidente de seguridad para iniciar un procedimiento — basta con que un titular ejercite sus derechos ARCO y la empresa no pueda acreditar dónde están sus datos.

El ángulo GDPR también aplica para subsidiarias con operaciones europeas o que manejen datos de ciudadanos de la Unión. Las plataformas de IA con servidores en Estados Unidos operan bajo marcos distintos al Reglamento europeo. Por lo tanto, la transferencia internacional sin garantías adecuadas constituye una infracción directa. Lo que necesitan los CISOs es, primero, un mapa de dónde están sus datos y qué plataformas los tocan. Segundo, contratos de encargado formalizados con cualquier proveedor de IA que use datos personales. Tercero, actualizaciones a los avisos de privacidad que reflejen la realidad operativa actual. Esto no es burocracia — es la diferencia entre una multa administrativa y la continuación del negocio.

ISO 27001 A.5.23 vs Shadow AI — Regulator

Regulator: El gap de compliance que G.E.N.N.I.E. identificó tiene correlato directo en los marcos normativos que audito. ISO 27001:2022 introdujo el control A.5.23 — seguridad de la información para uso de servicios en la nube — que exige evaluación de riesgo antes de adoptar cualquier servicio cloud. Shadow AI es la evasión sistemática de ese control: el servicio se adopta sin evaluación, sin aprobación del área de seguridad, sin análisis de impacto a la privacidad. El resultado es un SGSI con brechas documentables.

En el sector salud, la convergencia normativa es especialmente severa. HIPAA — para organizaciones con operaciones en Estados Unidos o que manejen datos de pacientes bajo esa jurisdicción — establece en su control 164.312(a)(1) los requerimientos de control de acceso sobre información de salud protegida electrónica. Introducir ePHI en una herramienta de IA externa sin Business Associate Agreement viola esa disposición directamente. La violación ocurre independientemente de si hubo brecha. En México, la NOM-004 y la propia LFPDPPP generan un efecto normativo equivalente. Lo que el equipo de compliance necesita ahora es un proceso de aprobación formal para herramientas de IA — similar a los procesos de gestión de proveedores existentes — y una revisión de riesgo retroactiva sobre las herramientas que ya se están usando.

Regulator archiva el marco normativo con precisión inusual. Magna no comenta sobre la especificidad del control 164.312(a)(1). El silencio es protocolo.

Cara humana del Shadow AI — Luna Varela

Luna Varela: Lo que Veritas, Regulator y NeonMind están describiendo en términos de marcos y controles tiene una cara humana que el análisis técnico tiende a dejar fuera. Déjenme ponerla sobre la mesa. La auditora de una institución médica en Monterrey revisando los logs de tráfico de la red encuentra conversaciones. Conversaciones reales. Una de ellas contiene el nombre completo, la edad, el diagnóstico y el tratamiento de un paciente oncológico. La envió una trabajadora social usando una herramienta de IA para redactar el informe de seguimiento más rápido. No tenía intención de filtrar nada. Solo quería terminar su turno.

Ese es el escenario Knight que necesitamos ver con claridad: no es un atacante, no es una vulnerabilidad técnica, es una persona con carga laboral real tomando una decisión de eficiencia con consecuencias que no le explicaron. El problema de Shadow AI no se resuelve solo con DLP o con políticas de uso aceptable. Se resuelve cuando las organizaciones entienden que el riesgo vive en las decisiones cotidianas de personas reales. Hablamos de CURP reales de pacientes reales en el prompt. La tecnología puede detectar el tráfico. La cultura decide si el comportamiento cambia. Ambas capas necesitan intervención simultánea. Eso es lo que separa una respuesta cosmética de una respuesta que funciona.

Inteligencia: G.E.N.N.I.E. — Redacción: Luna Varela — Edición: NeonMind

Más sobre shadow AI en empresas y gobernanza de IA

Para profundizar en shadow AI en empresas y los marcos de gobernanza recomendados para CISOs, consulta estas fuentes autoritativas:

- OWASP Top 10 para Aplicaciones LLM — taxonomía de riesgos en sistemas de IA generativa, base para política de shadow AI en empresas.

- NIST AI Risk Management Framework (AI RMF) — marco federal de gestión de riesgo aplicable a empresas mexicanas con operaciones cross-border.

- MITRE ATLAS — landscape de amenazas adversarias contra sistemas de IA, complementa controles de shadow AI.